Apache Spark là một công cụ mạnh mẽ trong xử lý dữ liệu lớn, mang lại hiệu quả và tốc độ vượt trội cho các ứng dụng về phân tích dữ liệu và trí tuệ nhân tạo. Bài viết này sẽ khám phá sâu hơn về vai trò của Spark trong Data Engineering, Data Warehouse, và Machine Learning, cùng những ứng dụng thực tế trong doanh nghiệp.

Trong bối cảnh dữ liệu lớn ngày càng phát triển, việc lựa chọn công cụ phù hợp cho từng nhu cầu xử lý dữ liệu là rất quan trọng. Bài viết này sẽ giúp bạn khám phá ba công cụ mạnh mẽ: Apache Spark, Apache Hadoop, và Apache Flink. Chúng ta sẽ so sánh đặc điểm, lợi ích, và hạn chế của từng công cụ để cung cấp cái nhìn tổng quan và chuyên sâu.

Apache Spark là một công cụ phân tích dữ liệu lớn mạnh mẽ và linh hoạt. Bài viết này hướng dẫn bạn từ cách cài đặt đến việc sử dụng Spark trong môi trường local và cluster. Bạn cũng sẽ học cách viết chương trình Spark đầu tiên của mình. Hãy bắt đầu hành trình khám phá và làm chủ Apache Spark.

Apache Spark là nền tảng xử lý dữ liệu mạnh mẽ được ưa chuộng trong thế giới Big Data. Với các API như DataFrame và Dataset, Spark giúp xử lý dữ liệu dễ dàng và hiệu quả. Bài viết này sẽ khám phá sự khác biệt giữa DataFrame, Dataset và RDD, cùng với các trường hợp cụ thể để áp dụng mỗi loại trong công việc hằng ngày.

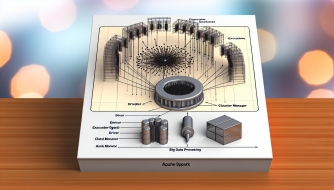

Apache Spark là một công cụ mạnh mẽ cho xử lý dữ liệu lớn. Bài viết này sẽ khám phá kiến trúc Spark với các thành phần chính như Driver, Executor, và cách chúng hoạt động trong một Cluster Manager. Qua đó, bạn sẽ hiểu rõ hơn về Workflow xử lý dữ liệu trong Spark.

Apache Spark là một nền tảng mã nguồn mở mạnh mẽ dành cho xử lý dữ liệu lớn. Nó mang lại khả năng xử lý dữ liệu nhanh chóng và hiệu quả, đặc biệt khi so sánh với các hệ thống như Hadoop. Bài viết này sẽ khám phá chi tiết về Apache Spark, từ kiến trúc cho đến ứng dụng thực tiễn.