Trong thời đại dữ liệu lớn, việc truy vấn dữ liệu một cách hiệu quả là yếu tố then chốt để tối ưu hóa hoạt động của các doanh nghiệp. Bài viết này sẽ khám phá các khái niệm quan trọng trong Dremio như Reflection, Caching và cách tối ưu hóa truy vấn để tăng tốc độ xử lý dữ liệu.

Trong thế giới dữ liệu lớn, lựa chọn công cụ query phù hợp có ý nghĩa quan trọng đối với hiệu suất và hiệu quả công việc. Bài viết này sẽ so sánh ba công cụ phổ biến: Dremio, Presto và Snowflake, lần lượt đi sâu vào từng đặc điểm và hiệu năng của chúng.

Trong bối cảnh dữ liệu lớn ngày càng phát triển, việc lựa chọn công cụ phù hợp cho từng nhu cầu xử lý dữ liệu là rất quan trọng. Bài viết này sẽ giúp bạn khám phá ba công cụ mạnh mẽ: Apache Spark, Apache Hadoop, và Apache Flink. Chúng ta sẽ so sánh đặc điểm, lợi ích, và hạn chế của từng công cụ để cung cấp cái nhìn tổng quan và chuyên sâu.

Apache Spark là nền tảng xử lý dữ liệu mạnh mẽ được ưa chuộng trong thế giới Big Data. Với các API như DataFrame và Dataset, Spark giúp xử lý dữ liệu dễ dàng và hiệu quả. Bài viết này sẽ khám phá sự khác biệt giữa DataFrame, Dataset và RDD, cùng với các trường hợp cụ thể để áp dụng mỗi loại trong công việc hằng ngày.

Trong kỷ nguyên dữ liệu lớn, Apache Spark nổi lên như một công cụ mạnh mẽ giúp xử lý dữ liệu phân tán hiệu quả. Tại trung tâm của Spark là RDD (Resilient Distributed Dataset), đóng vai trò quan trọng trong khả năng xử lý dữ liệu nhanh chóng và đáng tin cậy. Bài viết này sẽ khám phá chi tiết về RDD và các khía cạnh kỹ thuật liên quan.

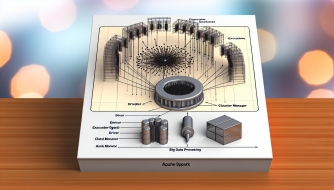

Apache Spark là một công cụ mạnh mẽ cho xử lý dữ liệu lớn. Bài viết này sẽ khám phá kiến trúc Spark với các thành phần chính như Driver, Executor, và cách chúng hoạt động trong một Cluster Manager. Qua đó, bạn sẽ hiểu rõ hơn về Workflow xử lý dữ liệu trong Spark.