Trong thời đại công nghệ đám mây, việc thiết kế hệ thống multi-tenant đã trở thành một phần không thể thiếu đối với các nhà phát triển SaaS. Bài viết này sẽ giúp bạn hiểu rõ về khái niệm multi-tenant, chuyên môn hóa trong cách ly dữ liệu khách hàng và các chiến lược thiết kế cho những hệ thống này.

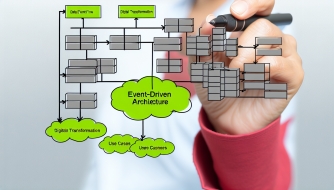

Kiến trúc Event Sourcing ngày càng trở nên quan trọng trong bối cảnh doanh nghiệp hiện nay. Nó cho phép ghi lại mọi sự thay đổi trạng thái, giúp tối ưu hóa quản lý dữ liệu và cải thiện khả năng mở rộng của hệ thống. Bài viết này sẽ đi sâu vào cách hoạt động của Event Sourcing, lợi ích và ứng dụng thực tế trong doanh nghiệp.

Dremio đang thay đổi cách các doanh nghiệp xử lý và phân tích dữ liệu, với một nền tảng thống nhất và hiệu quả cho các ứng dụng AI. Bài viết này sẽ cung cấp cái nhìn tổng quan về việc ứng dụng của Dremio trong các hệ thống doanh nghiệp hiện đại, từ cách nó được thiết kế đến việc tích hợp trong pipeline AI.

Trong kỷ nguyên dữ liệu hiện đại, việc lựa chọn giải pháp lưu trữ và quản lý dữ liệu phù hợp là rất quan trọng. Bài viết này so sánh Dremio, Data Warehouse và Data Lake, giải thích về các kiến trúc dữ liệu khác nhau và điều kiện sử dụng của Dremio để giúp bạn đưa ra quyết định sáng suốt.

Dremio là một nền tảng SQL phân tán giúp phân tích dữ liệu lớn một cách hiệu quả. Bài viết này sẽ đi sâu vào kiến trúc của Dremio, khám phá cách các thành phần như Coordinator Node và Executor Node hoạt động, và làm sáng tỏ cơ chế của Query Engine, từ đó giúp bạn hiểu rõ hơn về hệ thống mạnh mẽ này.

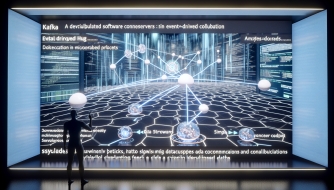

Trong bài viết này, chúng ta sẽ khám phá cách mà kiến trúc điều khiển sự kiện và hệ thống streaming sự kiện, cụ thể là Kafka, đang cách mạng hóa cách chúng ta xây dựng và triển khai các ứng dụng phân tán. Từ khái niệm cơ bản đến ứng dụng thực tiễn trong microservices, Kafka chứng minh khả năng mạnh mẽ của mình trong việc xử lý và truyền tải dữ liệu theo sự kiện.

Trong kỷ nguyên của các hệ thống phân tán và microservices, Apache Kafka nổi lên như một công cụ quan trọng giúp quản lý và điều phối các dịch vụ. Nó cung cấp một nền tảng mạnh mẽ cho việc xử lý và truyền tải dữ liệu theo thời gian thực, hỗ trợ các hệ thống hiện đại trở nên linh động và hiệu quả hơn.

Apache Kafka là một nền tảng xử lý sự kiện phân tán và lưu trữ được phát triển bởi Tổ chức Phần mềm Apache. Bài viết này sẽ khám phá cách mà Kafka hoạt động với kiến trúc độc đáo của mình, từ cấu trúc của broker, cluster cho đến cách nó xử lý dòng dữ liệu mạnh mẽ và hiệu quả.

Trí tuệ Tổng quát Nhân tạo (AGI) là mục tiêu lớn của nhiều công ty công nghệ, với khả năng vượt trội so với trí tuệ con người trên hầu hết các tác vụ nhận thức. Bài viết này sẽ đi sâu vào kiến trúc, các thành phần và cách AGI hoạt động với các khả năng như ghi nhớ, lý luận và học hỏi.

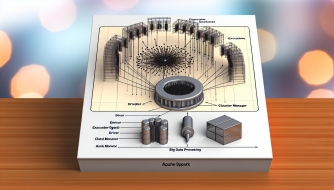

Apache Spark là một công cụ mạnh mẽ cho xử lý dữ liệu lớn. Bài viết này sẽ khám phá kiến trúc Spark với các thành phần chính như Driver, Executor, và cách chúng hoạt động trong một Cluster Manager. Qua đó, bạn sẽ hiểu rõ hơn về Workflow xử lý dữ liệu trong Spark.