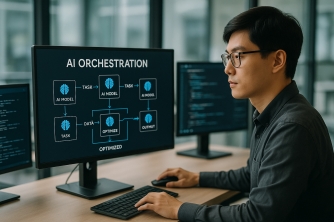

Trong bối cảnh công nghệ phát triển nhanh chóng, điều phối AI (AI Orchestration) đang trở thành một yếu tố quan trọng. Hệ thống này không chỉ giúp tổ chức và quản lý các tác vụ AI phức tạp mà còn tối ưu hóa quy trình làm việc với nhiều công cụ AI khác nhau. Bài viết này sẽ khám phá sâu hơn về khái niệm và ứng dụng của điều phối AI.

Trong kỷ nguyên số hóa, việc tích hợp dữ liệu từ nhiều nguồn là nhiệm vụ quan trọng đối với các doanh nghiệp. Bài viết này sẽ tìm hiểu khái niệm "tích hợp dữ liệu", vai trò của pipeline ingestion trong hệ thống tích hợp và giới thiệu các công cụ phổ biến giúp tối ưu hóa quy trình này.

Bạn có bao giờ tự hỏi dữ liệu của mình có độ tin cậy cao như thế nào? Với sự phát triển của các công cụ giám sát tính quan sát dữ liệu, doanh nghiệp có thể dễ dàng phát hiện và khắc phục lỗi trong pipeline dữ liệu của mình. Khả năng này không chỉ bảo vệ tính toàn vẹn dữ liệu mà còn tối ưu hóa quá trình ra quyết định dựa trên dữ liệu.

Trong kỷ nguyên số hiện nay, tự động hóa bằng AI trong kiểm thử phần mềm đang trở thành xu hướng. Hệ thống pipeline tự động hóa kiểm thử AI, cùng với các công cụ tạo kiểm thử đơn vị và quy trình làm việc tự động hóa, giúp giảm thời gian và chi phí phát triển phần mềm đáng kể. Bài viết này sẽ khám phá chi tiết các khía cạnh này.

Trong bối cảnh công nghệ AI ngày càng phát triển, việc áp dụng các công cụ debugging nâng cao và quy trình phân tích lỗi đóng vai trò quan trọng trong việc duy trì hiệu suất của hệ thống. Bài viết này khám phá sâu các phương pháp và công cụ giúp phát hiện và khắc phục lỗi trong hệ thống AI.

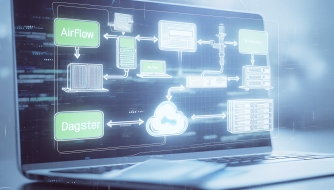

Trong thời đại công nghệ số, việc tổ chức và quản lý dữ liệu đóng vai trò then chốt trong việc vận hành doanh nghiệp. Các công cụ như Airflow và Dagster đang dẫn đầu trong việc cung cấp giải pháp orchestration cho pipeline dữ liệu. Bài viết này sẽ giúp bạn hiểu rõ hơn về hệ thống này, cùng các công cụ và khái niệm cơ bản liên quan.

Dremio đang thay đổi cách các doanh nghiệp xử lý và phân tích dữ liệu, với một nền tảng thống nhất và hiệu quả cho các ứng dụng AI. Bài viết này sẽ cung cấp cái nhìn tổng quan về việc ứng dụng của Dremio trong các hệ thống doanh nghiệp hiện đại, từ cách nó được thiết kế đến việc tích hợp trong pipeline AI.

Apache Kafka là một nền tảng lưu trữ và xử lý sự kiện phân tán mạnh mẽ, đóng vai trò quan trọng trong các mô hình AI và máy học hiện đại. Với khả năng xử lý dữ liệu thời gian thực nhanh chóng và hiệu quả, Kafka hỗ trợ tối ưu hóa quy trình phân tích thông tin từ nguồn dữ liệu đa dạng, cải thiện khả năng ra quyết định tự động.

Apache Kafka là công nghệ hàng đầu trong việc xây dựng hệ thống xử lý dữ liệu real-time. Được biết đến với khả năng mạnh mẽ trong việc xử lý và tích hợp nhiều loại dữ liệu từ nhiều nguồn, Kafka không chỉ là phần mềm lưu trữ mà còn cung cấp nền tảng vững chắc cho các hệ thống phân tích dữ liệu hiện đại, đặc biệt là các hệ thống ETL.

Apache Kafka là một công cụ mạnh mẽ trong việc xây dựng hệ thống xử lý dữ liệu thời gian thực. Bài viết này sẽ đi sâu khám phá vai trò của Kafka trong việc thiết kế các hệ thống ETL và Data Pipeline, từ đó giúp tối ưu hóa quy trình phân tích và quản lý dữ liệu.