Neural network là một mô hình học máy dựa trên cấu trúc của não bộ con người, nơi mạng nơron nhân tạo được kết nối để học hỏi từ dữ liệu. Trong bài viết này, chúng ta sẽ tìm hiểu về cách mạng nơron được đào tạo thông qua các thuật toán như backpropagation và gradient descent, cũng như vai trò của hàm mất mát trong quá trình này.

Trong bối cảnh phát triển mạnh mẽ của trí tuệ nhân tạo, Forward Propagation và Backpropagation đóng vai trò là nền tảng để giúp các mạng neuron học hiệu quả. Bài viết này sẽ khám phá cách các quá trình này hoạt động, ý nghĩa toán học đằng sau chúng và cách ứng dụng trong các mô hình học sâu hiện đại.

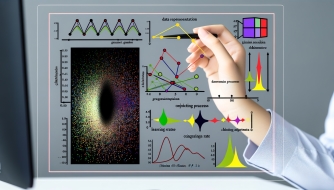

Bài viết sẽ khám phá các khái niệm cơ bản về dữ liệu, Gradient Descent, Learning Rate và cách tối ưu hóa hàm mất mát trong học máy. Hiểu sâu hơn về những khái niệm này sẽ giúp độc giả tiếp cận với các kỹ thuật quan trọng trong lĩnh vực này.