Trong thế giới công nghệ phát triển nhanh chóng, việc theo dõi và quản lý hệ thống qua log là vô cùng quan trọng, đặc biệt với các tổ chức lớn. Apache Kafka nổi lên như một giải pháp mạnh mẽ cho vấn đề này nhờ khả năng thu thập, xử lý dữ liệu log hiệu quả từ nhiều nguồn khác nhau, giúp tối ưu hóa hệ thống một cách đáng kể.

Apache Kafka đang cách mạng hóa ngành tài chính bằng cách cung cấp các giải pháp xử lý dữ liệu mạnh mẽ cho các hệ thống ngân hàng và fintech. Bằng cách tận dụng sức mạnh của Kafka, các tổ chức không chỉ phát hiện gian lận tài chính theo thời gian thực mà còn tối ưu hóa toàn diện các quy trình nghiệp vụ, từ dịch vụ khách hàng đến quản lý rủi ro.

Với sự bùng nổ của dữ liệu lớn, nhu cầu phân tích dữ liệu thời gian thực ngày càng trở nên quan trọng. Apache Kafka nổi bật như một công cụ mạnh mẽ trong việc xử lý dữ liệu streaming. Bài viết sẽ giới thiệu về khả năng phân tích dữ liệu thời gian thực của Kafka từ nguyên lý hoạt động, kiến trúc, đến các trường hợp sử dụng thực tế.

Apache Kafka là một nền tảng phân phối và xử lý sự kiện mạnh mẽ, được sử dụng rộng rãi trong việc quản lý dữ liệu thời gian thực. Tuy nhiên, việc sử dụng Kafka không phải lúc nào cũng dễ dàng và thường dẫn đến một số sai lầm phổ biến. Bài viết này sẽ thảo luận về những lỗi thường gặp khi sử dụng Kafka và cách khắc phục chúng để đảm bảo hệ thống hoạt động hiệu quả.

Trong bài viết này, chúng ta sẽ khám phá cách mà kiến trúc điều khiển sự kiện và hệ thống streaming sự kiện, cụ thể là Kafka, đang cách mạng hóa cách chúng ta xây dựng và triển khai các ứng dụng phân tán. Từ khái niệm cơ bản đến ứng dụng thực tiễn trong microservices, Kafka chứng minh khả năng mạnh mẽ của mình trong việc xử lý và truyền tải dữ liệu theo sự kiện.

Với sự phát triển mạnh mẽ của công nghệ dữ liệu lớn, Apache Kafka đã trở thành một phần không thể thiếu trong hệ thống xử lý dữ liệu thời gian thực. Bài viết này sẽ giúp bạn hiểu rõ về các công cụ giám sát Kafka, các chỉ số quan trọng và tầm quan trọng của việc giám sát hệ thống Kafka để đảm bảo hiệu suất và tính ổn định.

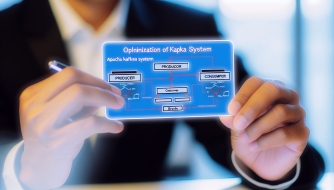

Apache Kafka là một nền tảng xử lý sự kiện phân tán giúp xử lý và truyền tải dữ liệu theo thời gian thực với hiệu suất cao. Để tối ưu hóa hoạt động của Kafka, cần có sự tinh chỉnh từ các thành phần như producer, consumer và broker. Bài viết này sẽ hướng dẫn bạn các kỹ thuật cơ bản và nâng cao để đạt hiệu suất tốt nhất từ Kafka.

Apache Kafka là một công cụ chủ đạo trong việc xử lý và phân tích dữ liệu theo thời gian thực. Sự tích hợp hiệu quả của Kafka vào quy trình AI (Trí tuệ nhân tạo) và Machine Learning không chỉ đẩy nhanh quá trình phân tích mà còn cải thiện độ chính xác trong việc đưa ra các quyết định dựa trên dữ liệu. Bài viết này sẽ đi sâu vào vai trò của Kafka trong các hệ thống này.

Trong kỷ nguyên công nghệ hiện nay, việc xử lý và phân tích dữ liệu thời gian thực trở nên cấp thiết đối với các doanh nghiệp. Sự kết hợp giữa Apache Kafka và bảng điều khiển thời gian thực mang lại khả năng phân tích dữ liệu mạnh mẽ, giúp tối ưu hóa quyết định kinh doanh và nâng cao hiệu quả hoạt động.

Trong kỷ nguyên của các hệ thống phân tán và microservices, Apache Kafka nổi lên như một công cụ quan trọng giúp quản lý và điều phối các dịch vụ. Nó cung cấp một nền tảng mạnh mẽ cho việc xử lý và truyền tải dữ liệu theo thời gian thực, hỗ trợ các hệ thống hiện đại trở nên linh động và hiệu quả hơn.